12. März 2026 von Dr. Volker Mull

Zero Trust, volle Wirkung: Architekturen, die Versicherung und KI verbinden

Ansätze, um moderne KI-Anwendungen mit bestehenden Versicherungslandschaften stabil und sicher zusammenzuführen

Wie können bestehende Versicherungsanwendungen stabil und zukunftsorientiert mit Chatbots und anderen KI-Lösungen verbunden werden? Ich zeige euch, wie neue Anwendungen für die Versicherungsprozesse der Zukunft das volle Potential vorhandener Daten und Wissen im Unternehmen ausschöpfen. Das Ziel: ein verbessertes Kundenerlebnis und effizientere Prozesse.

Mit offenen, API-getriebenen Integrationsmustern und standardisierten Protokollen lassen sich bestehende IT-Ressourcen mit neuen Agenten flexibel, sicher und compliant kombinieren. Eine strukturierte Zielarchitektur mit einer Anbindung der KI-basierten Komponenten über das Message Context Protocol „MCP“, der gezielte Einsatz von Agenten und Retrieval Augmented Generation (RAG) sowie eine konsequente Service-Orientierung (REST/Events) für den Zugriff auf strukturierte Daten sorgen für eine Entkoppelung, Wiederverwendung und durchgängige Nachvollziehbarkeit.

Nichtfunktionale Anforderungen an die Nachvollziehbarkeit, Überprüfbarkeit und Sicherheit werden erfüllt durch:

- eine durchgängige Governance für Modelle und Daten,

- eine vollständige Observability aller Ressourcen,

- die Steuerung der Zugriffe durch den Einsatz eines Identity Access Managements „IAM“

- und eine rollenbasierten Berechtigungssteuerung „RBAC“.

Jeder Zugriff wird autorisiert („Zero Trust“). Eine Klassifizierung aller Daten, strukturiert oder unstrukturiert, sowie das Prinzip der Datenminimierung sorgen für die Einhaltung des Datenschutzes.

Für die Governance werden Audit-Trails (Protokollierung und Kontrolle der KI-Nutzung durch Prompts und Outputs) sowie Policy Enforcement eingesetzt.

So entstehen belastbare, Release fähige KI-Lösungen, die bestehende Kernsysteme sicher erweitern und messbar schnellen Mehrwert liefern.

Wie wird die heutige Versicherungs-IT voll KI-fähig ?

Versicherer stehen unter Druck, Servicequalität zu steigern, Kosten zu senken und gleichzeitig regulatorische Anforderungen einzuhalten. Business und Kundschaft erwarten moderne User-Journeys, aktuelle Use-Cases und kurze Time-to-Market für neue KI-Features. KI-gestützte Chatbots, Assistenten für Sachbearbeitende und intelligente Automatisierung in den Prozessen adressieren diese Ziele. KI-Anwendungen mit einer Verbindung zu bestehenden Daten sind

- Kunden-Self-Service: kombiniert AVBs, Tarifinformationen und individuelle Vertragsdaten

- Interne Expertenassistenz: kontext- und prompt-basierte Zusammenstellung von internen Richtlinien, E-Mails, Gutachten oder Gerichtsentscheidungen

- Vertriebsunterstützung: Abgleich der Kundenwünsche mit Produktbeschreibungen, Beratungsrichtlinien und internen Vorgaben

- Schaden & Leistung: Zusammenfassung großer Vorgangsakten

Wie können diese KI-Anwendungen sauber in die bestehende Anwendungslandschaft integriert werden? Die Systeme der Versicherer sind oft monolithisch und historisch gewachsen. Sie werden zunehmend durch Einführung von API-orientierten Plattformen modernisiert.

Eine entkoppelte, API-getriebene Versicherungsplattform

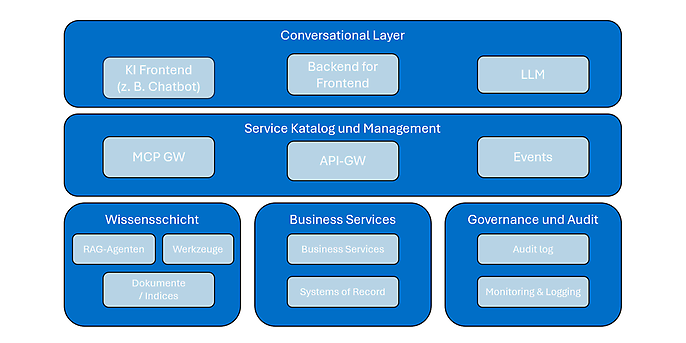

Kernidee einer zukunftsfähigen KI-fähigen Versicherungslandschaft ist eine Entkoppelung in der Zielarchitektur, so dass bestehende Fachlogik und Datenhaltung über Services bereitgestellt werden und KI-Anwendungen klar getrennt und über standardisierte APIs gebunden werden.

Im Conversation Layer werden die KI-Frontend-Komponenten und die Integration des LLMs angeordnet. Hierzu zählen Kundenchatbots, Assistenten, Recommendation-Services, Werkzeuge für Datenanalyse und Extraktion oder Decision Engines. Sie werden über Backend- und Unterstützungskomponenten mit dem LLM verbunden.

MCP als Abstraktionsschicht

Für die Anbindung an die Versicherungsanwendungslandschaft bietet sich das Model Context Protocol (MCP) als standardisiertes Protokoll an. Fachliche Funktionen werden als klar definierte MCP-Tools exponiert, die von den KI-Modellen genutzt werden. Ein MCP-Gateway wirkt wie eine Abstraktionsschicht zwischen LLM/Chatbot und den Backend-Fähigkeiten. Bei einem Modellwechsel (anderer Provider, On-Prem-Modell) kann die Integration der Daten und Werkzeuge erhalten bleiben und „nur“ der „Model-Adapter“ verändert werden. Dadurch wird die Abhängigkeit vom konkreten Modell und seinem Anbieter verringert (kein „Modell-Lock-in“)

Fachlich korrekte, aktuelle und revisionssichere Antworten können über Agenten in der Wissensschicht erreicht werden, die an die Modelle angebunden werden.

Der Zugriff auf die strukturierten Daten (über REST-APIs oder Events) geschieht „hinter“ MCP. Fachliche Services bieten stabile APIs für die „Systems of Records“, während KI-Services als lose gekoppelte Konsumenten dieser APIs agieren und unabhängig skalieren können.

Sicherheits- und Compliance-Anforderungen werden konsequent umgesetzt: MCP-Tool-Aufrufe laufen über IAM, API-Gateway und Policy-Engine, Daten werden vor der Modellnutzung klassifiziert und minimiert, und alle Interaktionen sind auditierbar. Gleichzeitig bleiben die Tools unabhängig vom konkreten Modell oder Kanal und können von Kundenchatbots, internen Assistenten und weiteren KI-Anwendungen wiederverwendet werden.

Wissensbasis: Retrieval-Augmented Generation (RAG)

Agenten in einer Retrieval Augmented Generation liefern Antworten auf der Basis von indizierten Dokumenten und Informationen, ohne Daten ins Modell „einzubrennen“. Ein RAG-Agent versorgt das Large Language Model mit den notwendigen Informationen beziehungsweise Textpassagen und nutzt

- Produkt-/Tarifdokumente

- AVB, Bedingungen, Richtlinien, Prozesshandbücher

- Wissensdatenbanken, FAQ, Schulungsunterlagen

- kontextbezogene Vertrags-/Schadendokumente

Wenn Dokumente indiziert und über eine Vektor- und Metadatensuche bereitgestellt werden, kann jede Antwort kann auf ihre Quellen zurückgeführt werden. Die indizierten Dokumente bilden die „single source of truth“, die in einem Redaktionsprozess bearbeitet und bereitgestellt werden kann.

Microservices, APIs und Events

KI-Anwendungen und Chatbots benötigen in Dialogen häufig spezifische Antworten über synchrone Service-Aufrufe. Wenn moderne Versicherungsanwendungen und -plattformen fachlich geschnittene Microservices bieten, wird die Fachlogik gekapselt und domänen-orientiert angeboten. Das API-Gateway liefert Routing, Authentifizierung und Transformation beim Zugriff auf die strukturierten Daten. RESTful APIs werden auch in den MCP-Tools angebunden. Stabile, versionierte MCP-Schnittstellen entkoppeln die KI-Anwendungen von der Plattform. Die Nutzung der Services wird durch Fehlerbehandlung stabilisiert, bei Störung oder Ausfall werden die Endanwender informiert („Wir reichen die Anfrage nach und melden uns per E-Mail“)

Eine Event-getriebene Integration (Events/Streams) als asynchroner Kommunikationsweg wird beispielsweise für den Anstoß von Folgebearbeitungen genutzt (Antragseinreichung, Vertragsänderung)

Governance

Die Governance im KI-Umfeld hat im Vergleich zu bisherigen Anwendungssystemen eine gesteigerte Bedeutung. Sie sorgt dafür, dass KI-Initiativen längerfristig beherrschbar bleiben; technisch, fachlich und regulatorisch, indem sie den Umgang mit den eingesetzten Modellen, die Nutzung der notwendigen Daten, die Bewertung der genutzten Prompts und die Kontrolle der erzeugten Outputs regelt.

Zur Model-Governance gehört neben dem Modell-Katalog (welches Modell wird für welchen Use Cases eingesetzt?) auch das Lifecycle Management der KI-Lösungen mit Quality Gates, Release-Prozessen und kontinuierlicher Verbesserung, sowie die Oberservability zum Monitoring des Einsatzes und die Explainability zur Dokumentation und Nachvollziehbarkeit von Aussagen.

Data Governance regelt den Umgang mit den Daten im Kontext von Datenschutz und regulatorischen Auflagen. Der Datenschutz wird optimalerweise „by Design & by Default“ verfolgt:

Datenklassifizierung

- Wie werden die Daten klassifiziert (öffentlich, intern, vertraulich, besonders schützenswert)?

- Wer ist verantwortlich (Ownership)?

- Wer darf sie sehen (Zugriffsrechte)?

Data Lineage

- Welche Daten werden in welchen Modellen mit welchen Outputs verwendet?

Data Minimization

- Welche Daten sind für den konkreten Use Case unbedingt nötig?

Eine Prompt-Governance reduziert unerwünschte Antworten, Datenlecks und Fehlinformationen bei generativen KI-Systemen, indem sie die verwendeten Prompts steuert. Dazu gehört zum Beispiel die Nutzung von vordefinierten Prompt-Templates aus einem Prompt-Katalog. Ein Audit-Trail entsteht, indem die Prompts mit dem Benutzerkontext sowie die erzeugten Antworten geloggt werden.

Die Output-Governance prüft die Antworten in einem Post-Processing. Sensible oder vertrauliche Daten werden nur bei Autorisierung weitergegeben. Rechtlich sensible Aussagen erfordern eine Prüfung und Freigabe. Bei Unsicherheiten oder komplexen Anfragen wird an menschliche Sachbearbeitende ausgesteuert.

Security und Zero-Trust

Eine KI-fähige Versicherungsarchitektur muss Zero Trust ernst nehmen: Kein System und kein User genießen grundsätzlich Vertrauen, jede Verbindung und jeder Zugriff wird explizit geprüft.

Für die Authentifizierung und Autorisierung wird ein Token-basiertes Identity und Access Management für Mitarbeitende und Partner, fall notwendig auch für die Endkundschaft, eingesetzt. Berechtigungen (RBAC, ggf. ABAC = Attribute-Based Access Control) beschränken den Zugriff in den MCP-Tools und REST-APIs auf Daten und Ressourcen. MCP-Gateway, RAG-Agenten und das API-Gateway helfen bei der Kontrolle dessen, was die KI und die User dürfen. Chatbots und KI-Services arbeiten mit einem „Acting on behalf of“, so dass ein Bot nur das tut, was der jeweilige User darf. Eine analoge Berechtigungsprüfung erfolgt auch beim RAG-Zugriff auf Dokumente.

Die Gateways realisieren weitere Policy-Checks und bilden zentrale Stellen für Logging, Auditing und Nachvollziehbarkeit. Verschlüsselung und Netzwerksicherheit sind weitere elementare Funktionen.

Datensammlung für Betrieb und Steuerung (Observability)

KI-Services erhöhen die Komplexität für Betrieb und Steuerung der IT-Landschaft. Sammlung und Auswertung von Daten und Kennzahlen (Observability) für Verfügbarkeit, Kosten und Qualität sind unerlässlich. MCP- und API-Gateways bieten Anbindungen an standardisierte Protokollfunktionen und loggen jeden Zugriff mit Anfrage, Antwort oder Fehler. Monitoring-Dashboards oder End-To-End Tracing (mit Korrelationen über Service-Grenzen hinweg) unterstützen Betrieb und Fehleranalyse. Audit-Trails sammeln Informationen zur Nachvollziehbarkeit und Optimierung der KI-Funktionen. Neben den Informationen zum User und zum Modell werden die erstellten Antworten und die erzielte Qualität protokolliert. Weitere Kennzahlen wie die Erfolgsquote, Automatisierungsquote, Abbruchsquote oder die Bearbeitungs- und Antwortzeitenzeiten unterstützen die Analyse des Business-Values.

Fazit: Sichere KI-Integration als Wettbewerbsvorteil

Die Anbindung moderner Versicherungsplattformen an Chatbots und KI-Lösungen ist kein experimentelles Randthema mehr. Offene, API-getriebene Architekturen, klare Integrationsmuster, starke Security- und Governance-Konzepte sowie durchgängige Observability ermöglichen einen kontrollierten, stabilen und skalierbaren Einsatz der KI.

Wer jetzt eine entkoppelte, Zero-Trust-fähige Zielarchitektur realisiert, schafft die Grundlage für schnelle, Release fähige KI-Lösungen und damit für messbaren Mehrwert von modernen Versicherungsanwendungen der Zukunft.

Unser Angebot

- Wir transformieren eure Kernsysteme in eine Serviceplattform

- Wir implementieren Security, Governance und stabilen Betrieb für einen MCP Integration Layer

- Wir unterstützen Euch bei der Gestaltung neuer und individueller KI-Anwendungen, die unter Nutzung der bestehenden Anwendungslandschaft moderne Use Cases realisieren