16. April 2024 von Stephan Jager und Thorben Forke

Datenchaos per Knopfdruck

Herausforderungen und Risiken bei der Nutzung von Microsoft Copilot für Microsoft 365

Die Wunderwelt der KI scheint mehr denn je grenzenlos. Das Thema ist omnipräsent, nicht zuletzt durch die starke Investition von Microsoft in OpenAI und die darauf aufbauende Veröffentlichung von Copilot für Microsoft 365 als KI-Assistent in den täglich genutzten Office-Anwendungen im November 2023. Das Potential von Copilot für Microsoft 365 im Bereich Produktivitätssteigerung und Prozessoptimierung lässt sich bereits bei der ersten Nutzung erahnen. Doch bis dahin ist es für die meisten Unternehmen zunächst ein steiniger Weg mit den typischen Fragen, die bei der Einführung neuer Microsoft-Dienste immer zu beantworten sind. Das einfache "Anschalten" von Copilot für Microsoft 365 birgt die Gefahr, im Datenchaos zu versinken. In diesem Blog-Beitrag zeigen wir die wichtigsten Governance-Aspekte bei der Einführung von Microsoft 365 Copilot und anderen KI-Diensten, die auf Large Language Models basieren.

Übrigens, in unserem kostenlosen Webinar stellen wir euch konkrete Copilot-Use-Cases für die Finanzbranche vor.

Bei der Einführung von Generativer KI beschäftigt man sich in der Regel zunächst mit den potenziellen Einsatzgebieten der Technologie . Warum sollten wir als Unternehmen KI einsetzen? In welchen Geschäftsfeldern, in welchen Anwendungen? Wie sehen mögliche Anwendungsfälle aus? Und inwieweit sind bestehende Anwendungsbeispiele auf mein Unternehmen übertragbar? Viele Unternehmen sind bereits über dieses Stadium hinaus und wissen, wo und in welchen Bereichen KI-Dienste wie Copilot für Microsoft 365 zukünftig eingesetzt werden sollen. Im weiteren Verlauf stellt sich dann die Frage, wie KI-Dienste im Unternehmen implementiert und sicher eingeführt werden können. Dabei unterscheiden wir zwei Dimensionen:

- 1. Das Enablement, also die Befähigung der Mitarbeitenden zur Nutzung von KI-Diensten wie Copilot in den Microsoft 365 Apps (Outlook, Teams, Word, Excel, PowerPoint, etc.) durch Schulungen, Prompt-Training und begleitende Change-Management-Maßnahmen.

- 2. Governance, also die Entwicklung und Implementierung von Spielregeln und Rahmenbedingungen für die sichere und Compliance-konforme Nutzung von KI-Diensten in der eigenen Organisation.

Nachfolgend stellen wir die verschiedenen Governance-Aspekte und die jeweiligen Risiken und Herausforderungen bei Nicht-Beachtung dieser vor.

Herausforderungen und Risiken bei der M365 Copilot Einführung

Die Bereitstellung von Microsoft 365 Copilot ist schnell erledigt. Nachdem ein Administrator die Lizenz vergeben hat, kann es eigentlich losgehen. Nicht selten stellt sich jedoch schnell Ernüchterung ein und es treten folgende Probleme auf: Mitarbeitende sind unzufrieden mit irrelevanten Ergebnissen. Diese enthalten entweder veraltete Informationen, sind ungenau oder gehen völlig am Thema vorbei. Die erhoffte Entlastung durch den KI-Assistenten bleibt somit aus.

"Wenn Sie einen Scheißprozess digitalisieren, haben Sie einen Scheiß digitalen Prozess."

Thorsten Dirks (ehemaliger CEO der Telefonica Deutschland)

Auch wenn das berühmte Zitat von Thorsten Dirks hier nicht hundertprozentig zutrifft, so gilt es doch für den Einsatz von KI-Assistenten wie dem Microsoft 365 Copilot. Wird die KI mit alten, irrelevanten oder redundanten Daten gefüttert, erhält man auch alte, irrelevante oder redundante Antworten. Dieses Problem wird auch gerne als "Shit-In-Shit-Out-Prinzip" bezeichnet.

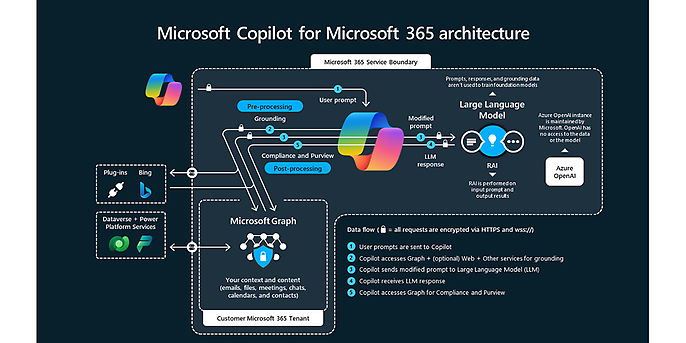

Eine weitere Herausforderung ergibt sich, wenn Mitarbeitende durch die Nutzung des KI-Assistenten Informationen von diesem erhalten, für die sie nicht berechtigt sind. Das System gibt Informationen aus, die der Nutzende nicht kennt und im schlimmsten Fall auch nicht kennen darf. Dieses häufig als "Oversharing" bezeichnete Problem ist auf eine mangelnde Kontrolle der vorhandenen Berechtigungen zurückzuführen. Häufig besteht dieses Problem schon länger im Unternehmen, es wird durch den Einsatz von KI-Assistenten nur deutlicher. Denn durch den sogenannten Grounding-Prozess, der bei der Verarbeitung des Prompts sowie der Generierung des Ergebnisses (Antworten) stattfindet, nutzt Microsoft 365 Copilot alle Dateien und Informationen, auf die das ausführende Benutzerkonto Zugriff hat. Dabei ist es unerheblich, ob die Anwenderin oder der Anwender Kenntnis von den Berechtigungen hat. Die Anwenderin oder der Anwender muss auch nicht nach Schlüsselwörtern suchen, die im Dateinamen, Titel oder Inhalt vorkommen. Mit Hilfe des "Semantec Index" stellt die KI selbstständig Beziehungen zwischen den Informationen her ( zum Beispiel Synonyme) und gibt diese kontextbezogen zurück. Dadurch wird das Problem des Oversharing deutlich sichtbarer und noch brisanter als beispielsweise bei Enterprise-Search-Projekten.

Microsoft-Darstellung der Datenverarbeitung inkl. Grounding-Prozess, Quelle: https://learn.microsoft.com/de-de/microsoft-365-copilot/media/copilot-architecture.png

Die Erwartungen an den KI-Assistenten sind hoch. Nicht selten weicht die anfängliche Neugier der Ernüchterung, wenn aus den oben genannten Gründen gute Ergebnisse ausbleiben. Bei der Einführung ist es daher ebenso wichtig, die Lizenzierung sinnvoll zu gestalten, klare Nutzergruppen und geeignete Anwendungsfälle zu definieren, damit der Mehrwert des Einsatzes in einem sinnvollen Verhältnis zum Aufwand steht. Ein weiteres Phänomen in vielen Kundenprojekten sind unzureichende Offboarding-Prozesse, die zu deaktivierten, aber noch lizenzierten Benutzerkonten führen.

Als Zwischenfazit lässt sich festhalten: Der Einsatz von Copilot für Microsoft 365 bringt einige (typische) Herausforderungen mit sich, die im Falle von Oversharing im schlimmsten Fall auch datenschutzrechtliche Konsequenzen haben können.

Organisatorische Maßnahmen zur optimierten Datenhaltung

Wie bereits beschrieben, kann "einfach einschalten" schnell zu Ernüchterung bei der Nutzung von Microsoft 365 Copilot führen. Um diese Ernüchterung zu vermeiden, können die folgenden Tipps & Tricks helfen, die Datenhaltung deutlich zu verbessern:

Die erste Maßnahme gegen das Shit-In-Shit-Out-Problem ist die Bereinigung von alten, redundanten und irrelevanten Informationen. Mit Hilfe von Analysewerkzeugen und Skripten können Informationen, die über einen längeren Zeitraum nicht geöffnet wurden, schnell identifiziert und bereinigt werden. Ähnlich wie beim "Frühjahrsputz" zu Hause kann so die Qualität der gespeicherten Daten und damit die Relevanz der KI-Ergebnisse erhöht werden. Darüber hinaus sollte darauf geachtet werden, welche Version der Daten wirklich aktuell ist. Nicht selten sieht man in Projekten Dokumente, die zum Beispiel mit V0.1 bis V1.8 gekennzeichnet sind. Meist werden diese Zwischenversionen nie mehr geöffnet, da sie nicht mehr relevant sind. Es empfiehlt sich, diese veralteten Zwischenversionen zu löschen. Werden diese älteren Versionen einer Datei dennoch benötigt, hilft die Versionshistorie in SharePoint Online weiter.

Eine recht einfache und ebenfalls sehr effektive Maßnahme ist die Organisation der Daten in logischen Verzeichnissen und Sites. Angenommen, ein Unternehmen nutzt SharePoint Online und Microsoft Teams als primäre Datenablage im Unternehmen, so empfiehlt es sich, für die einzelnen Abteilungen, Projekte und Anwendungsbereiche eigene Datenräume einzurichten. So werden HR-Daten idealerweise in einer eigenen HR-Bibliothek und IT-Dokumentationen in einer Dokumentenbibliothek der IT-Organisation abgelegt. Dies hilft zum einen bei der Berechtigungsverwaltung, zum anderen erleichtert es auch der KI, die Relevanz der Inhalte zu einem bestimmten Thema herzustellen.

Das Tagging von Dateien sowie die Verwendung von Metadaten im Kontext von SharePoint ist eine weitere Hilfestellung. Es hilft nicht nur den Anwendern, sich schneller in den Daten zurechtzufinden ( zum Beispiel über Ansichten, Gruppierungen und Filter), sondern auch dem Microsoft 365 Copilot, die Zusammenhänge der Informationen besser zu verstehen.

Als letzten Tipp empfehlen wir eine einheitliche Benennung der Dokumente. Ziel sollte es sein, eine einheitliche Strategie zu etablieren, wie Dokumente zu benennen sind, um relevante Informationen schneller zu finden beziehungsweise von der KI nutzen zu lassen.

Das liest sich natürlich viel einfacher, als es in der Praxis umzusetzen ist. In nicht wenigen Unternehmen herrschen chaotische Zustände in Microsoft Teams, SharePoint Online oder FileShare. Daher auch an dieser Stelle die dringende Empfehlung, die notwendigen Maßnahmen durch ein ganzheitliches Change Management begleiten zu lassen. Nur so kann ein Verständnis für die Spielregeln im Umgang mit Microsoft 365 Copilot aufgebaut werden.

Technische Maßnahmen für die Abbildung einer Data Governance

Neben den organisatorischen Maßnahmen, die umgesetzt werden sollten, gibt es auch eine Menge technischer Maßnahmen, die betrachtet werden müssen. Unsere Top fünf der möglichen Maßnahmen nachfolgend auf einen Blick:

- 1. Implementierung von Aufbewahrungs- und Löschrichtlinien mittels Purview Lifecycle Management

- 1. Wie lange müssen Daten aufbewahrt werden? Hier sind die gesetzlichen Vorschriften zu beachten.

- 2. Wann sollen Daten automatisiert bereinigt werden, um ein erneuten Chaos zu vermeiden?

- 2. Etablierung einer Dokumentenklassifizierungsstrategie, etwa auf Basis von Purview Information Protection:

- 1. Wer darf auf welche Informationen und Daten zugreifen?

- 2. Bitte beachtet hierbei, dass Microsoft Copilot für Microsoft 365 ebenfalls Rechte benötigt, um Daten verarbeiten zu können.

- 3. Stetige Überprüfung vorhandener Berechtigungen (Access Reviews):

- 1. Überprüfung von Zugriffen auf Teams, SharePoint (Online) Sites und FileShares (Rezertifzierung),

- 2. Löschung nicht mehr benötigter Berechtigungen und

- 3. Identifikation von Brüchen in der Berechtigungsvererbung, die beispielsweise durch Freigaben entstanden, sind.

- 4. Bewertung und Bereinigungen von Freigaben im Kontext SharePoint Online und OneDrive for Business:

- 1. Organisationsweise Freigaben,

- 2. Anonyme Freigaben und

- 3. Generierte Freigabelinks über Teams Chats

- 5. Optimierung der Lizenznutzung

- 1. Überwachung der Nutzung von Microsoft 365 Copilot,

- 2. Deaktivierung der Lizenzen für inaktive Anwenderinnen und Anwender sowie

- 3. Reduzierung der Speicherkosten (Verringerung der notwendigen Lizenzen) durch aufgeräumte Datenräume.

Ist eine Governance allein ausreichend?

Die Antwort lautet: NEIN. Die oben genannten Empfehlungen helfen Unternehmen und der eingesetzten Künstlichen Intelligenz, wie zum Beispiel Microsoft 365 Copilot, Daten besser und sicherer zu nutzen. Diese Maßnahmen reichen jedoch nicht aus, um Ihre Daten vor unbefugtem Zugriff zu schützen. Daher möchten wir an dieser Stelle darauf hinweisen, dass die Erstellung einer Sicherheitsstrategie sowie die Umsetzung von Sicherheitsmaßnahmen nach dem Zero-Trust-Modell unerlässlich sind. Dieses Thema ist jedoch so umfangreich, dass hierzu gesondertes Informationsmaterial auf unseren Kanälen zur Verfügung gestellt wird.

Webinar-Reihe

Microsoft Copilot & GenAI in der Finanzbranche

Generative KI und insbesondere Microsoft Copilot versprechen riesige Potentiale und Chancen für Automatisierung und Produktivitätssteigerung im regulierten Finanz- und Versicherungsumfeld.

Jetzt kostenloses Webinar zu konkreten Copilot-Use-Cases für die Finanzbranche ansehen

Zusammenfassung

Durch die Berücksichtigung der oben genannten Punkte im Bereich der Copilot Governance wird das Risiko eines ungewollten Datenchaos auf Knopfdruck nachhaltig reduziert. Eine starke Governance, nicht nur im Bereich Microsoft AI, schafft Vertrauen und Akzeptanz für die Nutzung des Dienstes im Produktivbetrieb. Getreu dem Motto "Ordnung ist das halbe Leben" ist eine Copilot Governance die entscheidende Voraussetzung für den sicheren Einsatz von Microsoft KI Services in der eigenen Organisation. Es ist wichtig, klare Richtlinien und Prozesse für die Nutzung, Speicherung und Klassifizierung von Dokumenten und Daten zu etablieren, um eine effektive und sichere Nutzung zu gewährleisten.

Werden entsprechende Maßnahmen und Richtlinien nicht sauber etabliert und von den Mitarbeitenden gelebt, erhöht sich das Risiko von Sicherheitsvorfällen oder Compliance-Verstößen signifikant. Durch den Einsatz von KI werden diese Risiken nun noch schneller sichtbar und haben durch die intelligente Datenverarbeitung der KI eine noch größere Wirkung.

Ihr möchtet mehr über spannende Themen aus der adesso-Welt erfahren? Dann werft auch einen Blick in unsere bisher erschienenen Blog-Beiträge.

Auch interessant: